[공지2] 주최측에서 경진대회 상금을 추가하기로 하였습니다.

- 상금 추가

- (기존) 1등 500만원

- (변경) 1등 500만원, 2등 100만원, 3등 50만원

[공지1] 주최측에서 경진대회 참여율이 저조한 것으로 판단하고 경진대회 연장 요청이 있었습니다. 이에 경진대회 기간을 연장하기로 하였습니다. 참가자분들은 착오 없으시길 부탁드립니다. 감사합니다.

- 경진대회 기간 변경

- (기존) 2020.11.23 ~ 2020.12.02. 23:59

- (변경) 2020.11.23 ~ 2020.12.05, 23:59

- 업데이트 내용

- (2020.12.02) 주최측의 요청에 따라 평가 정확도를 높이기 위해 채점 방식이 변경되었습니다. 기존 제출 스코어는 모두 자동 재산정되어 업데이트 됩니다. 상세한 내용은 [6.1 평가방법]을 참고바랍니다.

1. 배경

Credit: © Alfred-Wegener-Institut / Stefan Hendricks

- 해빙은 바다에 떠있으면서 지구로 들어오는 태양빛을 반사하는 “기온조절자”의 역할을 하고 있으며 여름철 북극 해빙이 최근 10년 간 15% 가량 줄어들 정도로 빠르게 감소하고 있는 추세입니다.

- 이에 AIFactroy는 인공위성 관측 자료를 활용해 북극 바다얼음, 해빙(海氷)의 변화를 예측에 적합한 프로토타입 모델 개발 및 성능분석을 추진하고자합니다.

- 북극 해빙의 변화가 한반도 이상기후에 영향을 준다는 연구결과가 꾸준히 나오고 있는 상황에서 위성영상 정보를 기반으로 인공지능(AI)을 활용해 북극 해빙 예측 모델을 개발하고자 합니다.

- 또한 북극항로 주변 해빙변화를 미리 예측함으로써 쇄빙연구선 아라온호가 안전하게 항로를 운행할 수 있도록 도움을 줍니다.

- 쇄빙연구선 아라온호는 해빙 예측 모델의 도움으로 안전한 위치에 해빙캠프를 설치한 뒤 해빙의 면적과 두께, 생태계 변화 등을 관측할 수 있습니다.

2. 주최/주관 및 참가 대상

- 주최 : 극지연구소

- 주관 : AIFactory

- 참가 대상 : 북극해빙 변화예측 알고리즘 개발에 관심 있는 일반인, 학생, 기업 등 누구나 (단, 14세 이상)

3. 데이터 제공

- https://aifactory.space 의 회원가입을 완료한 회원이 본 대회 참가를 할 경우에만 데이터 제공

- 회원가입 시 오류가 확인될 경우 가입 무효화 후 오류 메시지 팝업창 제시

- "대회 규칙"에 대한 동의가 있어야만 대회 참가 가능

4. 일정 (UTC+ 9(한국) 기준)

- 플랫폼 태스크 등록 및 경연대회 홍보: 2020.11.20

- 경연대회 : 2020.11.23 ~ 2020.12.05

- 1st랩 : 2020.11.23 ~ 2020.12.05, 23:59

※ 대회의 원활한 진행을 위해 일정은 변경될 수 있음.

5. 상금/수여팀

- 랩은 총 1회를 진행하며, 총 상금 500만원을 지급합니다.

- 상금 및 수여팀은 다음과 같습니다.

| 랩 | 수여팀 | 상금 |

|---|---|---|

| 1st랩 | 대회 기간 중 체크 포인트 (Check Point Time)를 거친 후 대회 기간 동안 최고점수를 달성한 1등 참가자에게 상금 지급 | 1등: 500만원 |

- 체크 포인트 (Check Point Time)

- 1st랩은 대회 기간 중 참가자가 제출한 답안지와 주관사가 보유한 정답지의 %27비교 & 검증%27을 1시간 단위로 수행함.

※ 참가자가 팀인 경우 팀의 대표에게 지급함.

6. 평가

6.1 평가 방법

- 오차값의 직관성을 높이기 위해 MAE(Mean Absolute Error)를 사용합니다.

- 해빙 외 영역의 스코어 개입을 최소화하기 위해 평가 대상 영역을 각 데이터 array의 [124:389, 34:265] 영역으로 한정합니다.

- 또한 육지지역값 및 관측 맹점지역값의 영향을 최소화하도록 평가대상 및 정답에 해빙-바다 영역만 계산되도록 하는 필터를 적용하여 결과를 산정합니다. 필터는 산정 배제좌표를 0, 산정 대상 좌표를 1로 기록한 numpy array로, 데이터 탭에서 다운로드하실 수 있으며, 필터가 적용된 스코어 계산식은 다음과 같습니다.

def filtered_mae(label, prediction):

imfilter = np.load(%27filter.npy%27)

prediction = imfilter * prediction

label = imfilter * label

return np.sum(np.abs(prediction - label))/np.sum(imfilter)

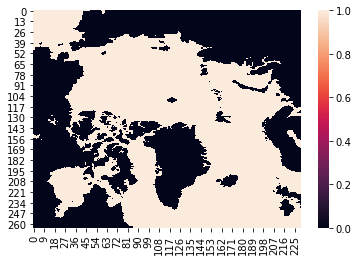

- 필터의 형태를 시각화하면 다음과 같습니다. (흑색: 점수 미반영지역, 백색: 점수 반영지역)

6.2 평가 과정

- ‘Public Score’는 리더보드 운영 기간 중에 확인 가능하며, ‘Private Score’는 리더보드 운영 기간 중에는 확인할 수 없으며, 대회 종료 이후에 공개됨.

- 단, Private Score는 마지막 제출 파일로 채점되므로, 참가자는 자신이 채점 받고 싶은 제출 파일을 최종적으로 갱신하여야 함.

- 랩별 종료일 이전에 목표점수 도달 시 리더보드 운영을 종료하고, Private Score 1순위 참가자는 AIFactory로 정해진 코드 양식에 맞는 코드파일과 제공되는 양식에 맞는 설명자료를 제출함.

- 평가는 다음과 같은 과정으로 이루어짐.

- A. 공개 랭킹 (Public Score): 대회 중 Test 데이터의 일부로 채점함.

- B. 최종 랭킹 (Private Score): Public Score에서 사용하지 않은 Test 데이터의 나머지로만 채점함 (랭킹에 사용되는 Test 데이터의 비율은 공개되지 않음).

- C. 종합 최종 랭킹 (Final Private Score): 랩별 대회기간 안에 정해진 코드 양식에 맞는 코드파일과 제공되는 양식에 맞는 설명자료를 제출한 상위 참가자 팀들을 대상으로 다음의 평가 기준을 바탕으로 종합 최종 랭킹을 공개함.

| 평가기준 | 평가비율 |

|---|---|

| Public Score 순위 | 100% |

| Private Score 순위 | 0% |

7. 대회 규칙 (중요)

※ 아래 내용에 대해서 동의 후 대회 참가할 수 있음.

7.1 외부 데이터 사용 관련

- 외부 공공 데이터 사용이 가능하나, 코드 제출 시 함께 제출

- 공공 데이터 외의 외부 데이터는 법적인 제약이 없는 경우에만 사용 가능

- 외부 데이터를 크롤링할 경우, 크롤링 코드도 함께 제출

7.2 팀 참가 관련

- 한 팀의 인원 제한은 없음.

- 팀 대표 1인만 대회참가 신청

- 제출은 반드시 팀 대표 1인의 아이디로 제출

- 팀이 수상하는 경우 팀 대표에게만 상금 지급